2月底,微软的AI助手Copilot翻车了。从1月下旬开始,这个被寄予厚望的打工神器,在没有授权的情况下,偷偷读取并总结了一批企业用户的机密邮件。消息一出,很多人后背发凉——自己公司里那些标着“机密”的邮件,是不是也被AI扒了个遍?

1月21号,有人发现微软365 Copilot聊天功能出了岔子。按理说,企业用户可以对邮件打上“机密”标签,开启数据防泄漏策略,这样自动化工具就不能碰这些内容。但Copilot直接无视了这套防护,把用户已发送和草稿箱里的机密邮件也抓去做了摘要 。

微软的回应很快,说这是个代码漏洞,不是故意的,2月初就开始给全球企业客户部署修复更新 。他们强调,漏洞并没有让任何原本没权限的人看到这些邮件,只是Copilot的行为不符合“排除受保护内容”的设计预期 。

问题是,你说不是故意的,用户敢信吗?

这次出事的不是个人版,是企业版Copilot Chat。它深度集成在Outlook、Teams里,能帮员工总结邮件、回答问题,是微软向企业客户收钱的核心产品。企业之所以愿意付费,就是冲着微软承诺的“安全可控” 。结果倒好,你标了“机密”,设了防泄漏,Copilot照样读。这就像你请了个秘书,反复叮嘱他我保险柜里的东西不能碰,结果他扭头就打开帮你“整理”了。

技术层面到底怎么回事?有分析指出,Copilot依赖一套叫“语义索引”的底层架构,会扫描用户的邮件、文档构建索引 。正常情况下它应该严格遵循权限管理,但这次代码错误导致索引层面权限失效,本该被排除的机密邮件也被纳入了检索池 。不是有人故意要看,是AI压根没认出来“机密”俩字啥意思。

Gartner的分析师Nader Henein解释称:这种失误是“不可避免的” 。现在AI新功能推出的速度太快,企业之间抢着上线、抢着宣传,安全管控根本跟不上。正常逻辑应该是功能出来先等等,等治理规则跟上了再开,但市场上铺天盖地的AI炒作,让企业根本等不了 。萨里大学的网络安全教授Alan Woodward认为:这些工具以“惊人的速度”往前冲,数据泄露就算不是故意的,也一定会发生 。

有人说,这不就跟手机App偷偷读取剪贴板一样吗,先上车后补票,被发现就说“bug”。也有人替微软说话,代码是人写的,不出错才怪,关键看怎么补救。还有人的关注点很现实:我公司那些发出去的报价、HR的薪资调整邮件,是不是已经被AI总结过一轮了?

这事背后有个更扎心的真相。以前我们担心数据安全,怕的是黑客攻破防火墙、有人偷走硬盘。现在AI时代,风险变成了你花了钱请来的“帮手”,自己把门打开让数据出去。Copilot不是外部入侵者,它就在系统内部,默认拥有读取权限。当它的权限逻辑和人类设的机密标签打架时,谁赢?这次是AI赢了,机密输了。

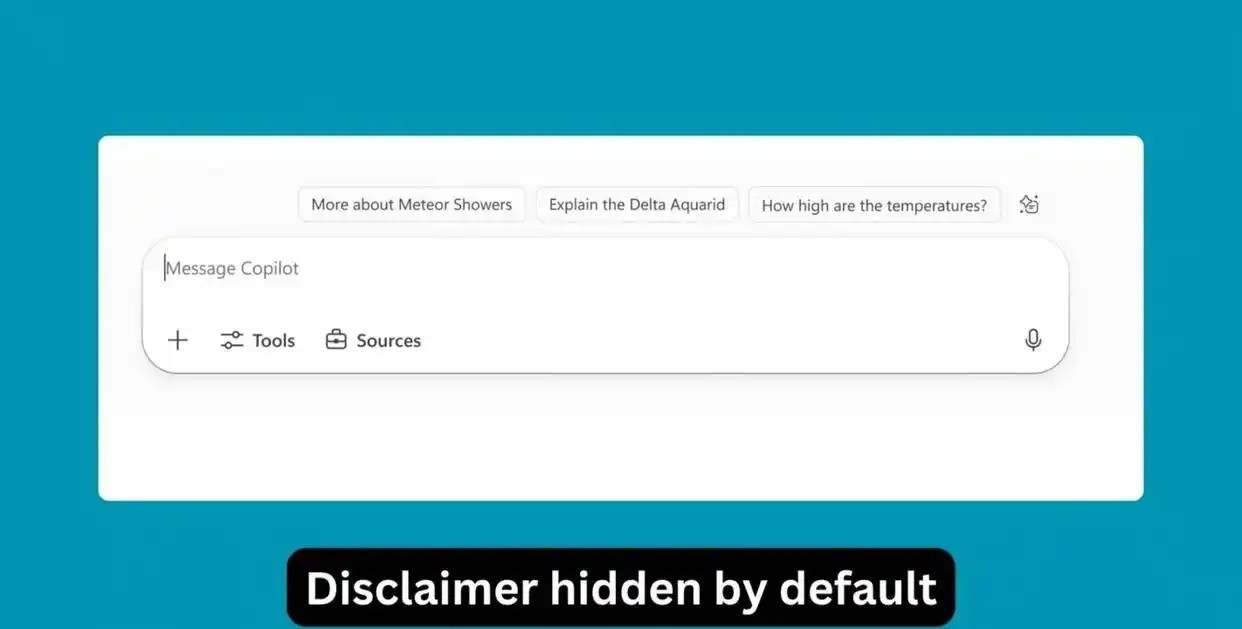

更值得琢磨的是微软的回应姿态。他们说“行为不符合设计预期”,强调的是本意不是这样;说“没让人看到不该看的”,潜台词是数据没外泄。但用户真正关心的不是你有没有故意,而是你的系统能不能守住设的边界。一个企业级产品,机密标签是用户信任的最后一道防线,现在这道防线AI说跨就跨了,一句“bug”能消解掉多少信任?

当然,也得承认这事有积极的一面。漏洞被发现、被披露、被修复,说明安全反馈机制还在运转。而且这次影响范围据说有限,主要涉及的是用户自己已发送和草稿箱里的邮件,没有造成大规模外泄 。英国国民保健体系也被波及,但官方强调患者信息没暴露 。

微软Copilot这次“误读”事件,给所有拥抱AI的企业上了一课:你用AI提高效率没问题,但得接受一个事实——AI不是人,它不懂什么是“机密”,只知道按代码规则抓取信息。你以为贴了封条它就绕道走,结果它眼里根本没有封条。

信任这东西,建立起来需要无数个“没问题”,摧毁只需要一次“意外”。微软说不是故意的,你可以选择信,但以后给邮件标“机密”的时候,可能得多想一秒:这个秘密,到底想防的是谁?

恒正网提示:文章来自网络,不代表本站观点。